複数のLLMを最適化!AIオーケストレーションで実現する次世代のAI導入成功事例

複数のLLMを最適化!AIオーケストレーションで実現する次世代のAI導入成功事例

生成AIや大規模言語モデル(LLM)の活用が当たり前になりつつある今、「どのモデルを選ぶか」以上に重要になっているのが、複数のLLMをどう組み合わせて最適化するかという視点です。この複雑な組み合わせと制御を可能にする考え方が、近年注目されているAIオーケストレーションです。

本記事では、複数のLLMを組み合わせて価値を最大化する「AIオーケストレーション」の基本概念から、具体的な活用パターン、導入時のポイント、そして次世代のAI導入成功事例の考え方までを、包括的に解説します。

1. AIオーケストレーションとは何か?

1-1. 単体LLMから「組み合わせの時代」へ

これまで多くの企業は、ChatGPT や Claude、Gemini など、1つのLLMを選定して社内利用するというアプローチを取ってきました。しかし実際には、

- 文章生成が得意なモデル

- コード生成に強いモデル

- 多言語翻訳や要約に優れたモデル

- 画像・音声・動画と連携しやすいマルチモーダルモデル

など、モデルごとに得意分野が異なります。そこで登場するのが「AIオーケストレーション」という発想です。

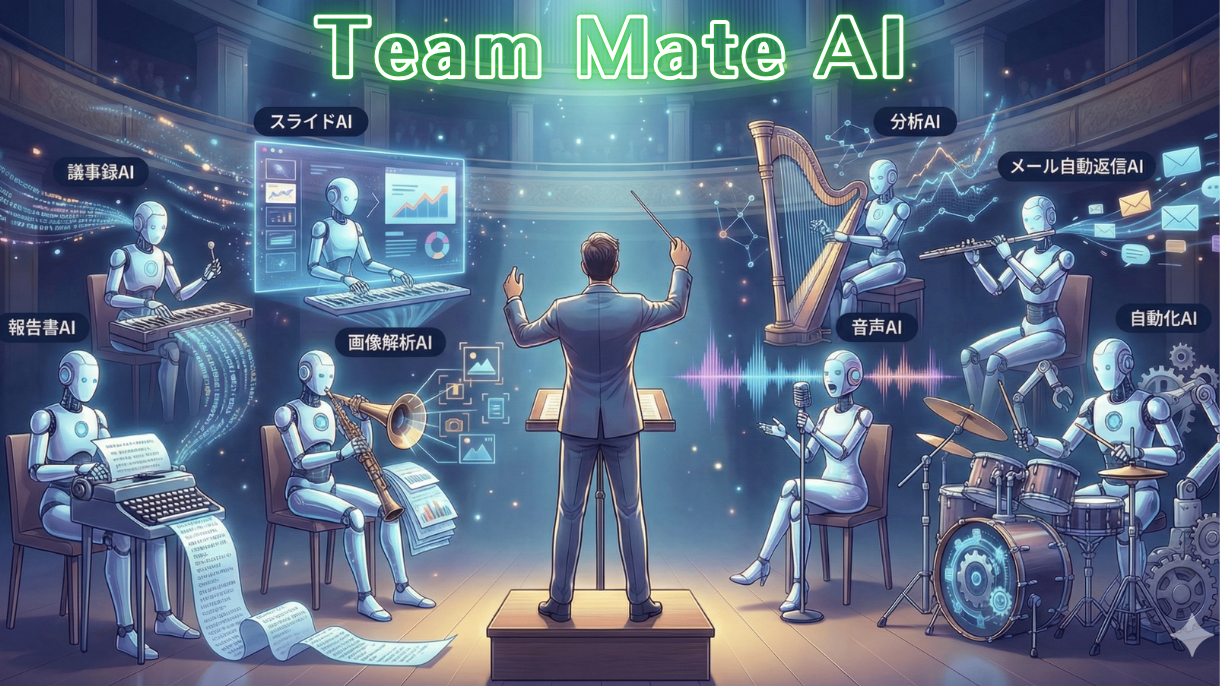

1-2. AIオーケストレーションの定義

AIオーケストレーションとは、

複数のAIモデル(特に複数のLLM)やツールを、目的に応じて組み合わせ・切り替え・連携させ、

全体として最適なアウトプットを生み出すための設計と制御のこと

を指します。音楽の指揮者(オーケストラのコンダクター)が、楽器ごとの特性を理解したうえで全体のハーモニーを作るように、AIオーケストレーションは「どのタスクをどのLLMに任せるか」を設計・制御する役割を果たします。

1-3. なぜ今、AIオーケストレーションが重要なのか

AIオーケストレーションが注目される背景には、次のような変化があります。

- LLMの種類が急増し、用途ごとにベストなモデルが分化している

- API経由での利用が一般化し、複数モデルを組み合わせやすくなった

- 企業は「全社標準モデル」だけではカバーしきれない業務ニーズを抱えている

- コストやレスポンス速度、精度のバランスを最適化する必要が高まっている

つまり、1つのモデルにすべてを任せるよりも、「タスクに合わせてモデルを使い分ける」ほうが、品質・コスト・スピードのすべてを最適化しやすい時代に入ったと言えます。

2. 複数LLMを組み合わせるメリット

AIオーケストレーションによって複数のLLMを活用するメリットは多岐にわたります。ここでは代表的なポイントを整理します。

2-1. タスクごとの「最適解」を選べる

モデルごとに得意・不得意がある以上、タスク別に最適なモデルを選択することが重要です。

- 高度な推論・長文読解 → 高性能LLM(例:GPT-4クラス)

- 定型文生成・簡易要約 → 軽量・安価なLLM

- 日本語に強いモデル → 日系ベンダーのLLM

- ソースコード生成 → コード特化型モデル

AIオーケストレーションを設計すれば、ユーザーや業務担当者は「裏側でどのモデルが動いているか」を意識せずに、常に最適なモデルの恩恵を受けられます。

2-2. コストとパフォーマンスのバランス最適化

高性能なLLMを常に使い続けると、API利用料やインフラコストが膨らみます。AIオーケストレーションでは、

- まず軽量モデルで一次回答・要約を実施

- 不確実性が高い問いや重要タスクのみ高性能モデルに回す

といった「段階的なモデル利用」が可能です。これにより、品質を落とさずにコストを30〜50%削減できるケースも珍しくありません。

2-3. ベンダーロックインを回避できる

特定のクラウドやベンダーのLLMだけに依存すると、

- 料金改定の影響をダイレクトに受ける

- 機能追加や制限の変更に左右されやすい

- 将来、新しい有力モデルが出ても乗り換えにくい

といったリスクが生じます。AIオーケストレーションの前提としてマルチLLM対応の設計をしておけば、新しいモデルの追加・切り替えが容易になり、長期的な柔軟性が高まります。

2-4. セキュリティやコンプライアンス要件に応じて制御

特に大企業や金融・医療などの業界では、データの扱いに厳しいルールがあります。AIオーケストレーションにより、

- 機密度が高いデータ → 社内閉域環境のLLM

- 一般公開情報のみ → 外部クラウドの高性能LLM

といったデータの重要度に応じたモデル選択が可能になり、セキュリティと利便性を両立できます。

3. AIオーケストレーションの代表的なアーキテクチャ

3-1. ルールベースのモデル切り替え

もっともシンプルなAIオーケストレーションは、あらかじめ決めたルールに従って、どのLLMを使うかを切り替える方式です。

例:

- プロンプト内の文字数が◯◯文字以上 → 高性能モデル

- ユーザー種別が「社外」 → セキュアな社内LLM

- タスク種別が「翻訳」 → 翻訳特化モデル

実装難易度は低く、既存のAPIゲートウェイやバックエンドにロジックを追加するだけでスタートできます。

3-2. メタLLMによる「モデル選択」アプローチ

より高度なアプローチとして、「どのモデルを使うか」を判断する専用のメタLLMを用いる方法があります。メタLLMが入力内容を分析し、

- 推論の難易度

- ドメイン知識の必要性

- 応答速度の要件

- コストの制約

などを踏まえて最適なモデルを選択します。この方式は、タスクが多岐にわたる大規模なAIプラットフォームで力を発揮します。

3-3. エージェントとツールによるワークフロー連携

最近では、LLMそのものを「エージェント」として扱い、複数のエージェントが役割分担しながらタスクを進める設計も増えています。

例:

- リサーチ担当エージェント(Web検索・社内ナレッジ検索)

- 要約・翻訳担当エージェント

- コード生成・自動テスト担当エージェント

- 最終レビュー・品質チェック担当エージェント

これらをまとめて制御する「オーケストレーター」が、ワークフロー全体の進行管理・結果統合・エラー処理を行う構成です。

4. 次世代のAI導入成功事例パターン

ここからは、AIオーケストレーションを取り入れた「次世代のAI導入成功事例」を、業務パターン別に紹介します。実在企業名は伏せますが、現場で実際に起こっている代表的なユースケースをイメージできるよう構成しています。

4-1. コンタクトセンターでのハイブリッド応答

大規模なコンタクトセンターでは、問い合わせ内容が多岐にわたるため、単一のLLMだけでは精度やコストの面で限界があります。AIオーケストレーションを活用した事例では、

- FAQレベルの問い合わせ → 軽量LLMが即時応答

- クレーム対応などセンシティブな案件 → 高性能LLM+人間オペレーターでハイブリッド対応

- 社内マニュアル参照が必要なケース → 検索特化モデル+RAG(検索拡張生成)で対応

といった形で、問い合わせ内容に応じて自動的にモデルが切り替わります。これにより、

- 顧客満足度の向上

- 応答時間の短縮

- オペレーターの負荷軽減

- AI利用コストの最適化

を同時に実現しています。

4-2. マーケティングコンテンツ制作のエンドツーエンド自動化

マーケティング部門では、多数のコンテンツ(ブログ、LP、広告文、SNS投稿など)を短期間で制作する必要があります。ある企業では、AIオーケストレーションを用いて、

- 市場調査エージェントがトレンド情報や競合事例をリサーチ

- 構成案作成エージェントが記事構成や見出し案を作成

- 本文生成エージェントが長文コンテンツを作成

- SEOチェックエージェントがキーワードや内部リンクを最適化

- 最終レビューエージェントがトーンや表現を整える

という一連のワークフローを自動化しました。この際、

- リサーチ → Web検索と相性が良いモデル

- 構成・本文生成 → 長文生成に強いモデル

- SEOチェック → ルールベース+軽量LLM

のように、工程ごとに最適なLLMを使い分けることで、コンテンツ制作のスピードとクオリティを両立しています。

4-3. ソフトウェア開発現場での「AIペアプロ」拡張

開発現場におけるAI活用として「AIペアプログラミング」が普及しつつありますが、AIオーケストレーションを取り入れた事例では、

- 仕様理解・要件整理 → 高性能LLMによる自然文解析

- 実装コードのドラフト生成 → コード特化型モデル

- テストコード自動生成 → テスト専用プロンプト+モデル

- 脆弱性チェック → セキュリティ特化ツール+LLMレビュー

といった形で、開発プロセス全体をAIが支援します。これにより、

- 開発スピードの向上

- バグの早期発見

- ドキュメント不足の解消

が実現し、「開発者の生産性30〜40%向上」という成果につながっているケースもあります。

4-4. ナレッジマネジメントと社内検索の高度化

社内文書やナレッジが増え続けるなか、「欲しい情報にたどり着けない」問題は多くの企業で共通です。AIオーケストレーションを活用したナレッジ基盤では、

- 検索クエリの意図理解 → 高性能LLM

- 文書検索 → ベクトル検索エンジン+軽量LLM

- 回答生成 → 長文要約に強いモデル

- 機密チェック → ポリシールール+LLMフィルタリング

という構成で、「社内版ChatGPT」のようなQ&A体験を実現しています。ここでも、文書の機密度に応じて利用するLLMを切り替えることで、セキュリティと利便性を両立しています。

5. AIオーケストレーション導入のステップ

実際に複数のLLMを最適化して活用するには、段階的な導入が重要です。ここでは、一般的な導入ステップを整理します。

5-1. 現状業務と課題の洗い出し

最初のステップは、「どの業務でAIが価値を出せるか」を明確にすることです。

- 時間がかかっている定型業務はどこか

- 属人化している業務はどこか

- 品質のばらつきが課題となっている領域はどこか

などを洗い出し、「この業務でAIを使えたらインパクトが大きい」という箇所に絞り込みます。

5-2. 利用候補LLMの選定と評価

次に、利用候補となるLLMをリストアップし、

- 日本語対応の精度

- ドメイン知識の有無

- 応答速度

- コスト

- セキュリティ・コンプライアンス

といった観点から評価します。この段階では、あえて1つに絞り込まず、複数モデルの比較検証を行うことがポイントです。

5-3. シンプルなオーケストレーションからPoCを開始

いきなり複雑なエージェント構成を組むのではなく、

- タスクA → モデルX

- タスクB → モデルY

といった単純なモデル切り替えロジックからPoC(概念実証)を始めるのがおすすめです。PoCのなかで、

- どのタスクにどのモデルがフィットするか

- レスポンス速度やコストの実測値

- ユーザー体験(UI/UX)の課題

を把握し、徐々にワークフローの自動化やエージェント連携へと発展させます。

5-4. ガバナンスと運用ルールの整備

AIオーケストレーションが本格稼働すると、利用部門が増え、用途も急速に拡大します。その前に、

- 利用可能なデータの範囲

- 個人情報・機密情報の取り扱いルール

- ログ取得とモニタリング方法

- プロンプトやテンプレートの管理ルール

などのガバナンスを明文化しておくことが重要です。特に複数のLLMを利用する場合は、モデルごとのデータ取り扱いポリシーの違いに注意が必要です。

5-5. 継続的なチューニングとモデル追加

AIオーケストレーションは「作って終わり」ではなく、継続的な改善サイクルが前提となります。

- 新しいLLMの登場やバージョンアップ

- 業務プロセスの変更

- ユーザーからのフィードバック

などを踏まえて、定期的にモデル構成やルーティングロジックを見直すことで、常に最適なAI基盤を維持できます。

6. 複数LLM最適化・AIオーケストレーションを成功させるポイント

最後に、複数LLMの最適化とAIオーケストレーションを成功させるための実践的なポイントをまとめます。

6-1. 「人間中心」の設計思想を忘れない

高度なAIオーケストレーションを設計するほど、つい技術的な複雑さに目が行きがちです。しかし最も重要なのは、

- 現場のユーザーがストレスなく使えるか

- 業務フローに自然に組み込めているか

- 最終的な意思決定は誰がどのように下すのか

といった「人間中心」の視点です。AIオーケストレーションは、あくまで人間の創造性や判断力を引き出すための裏方であることを意識しましょう。

6-2. 小さく始めて早く学ぶ

AI導入プロジェクトが失敗しがちなパターンのひとつが、最初から大規模で完璧なシステムを目指してしまうことです。AIオーケストレーションも同様で、

- 小さな業務プロセスから始める

- 利用者を限定したパイロットを実施する

- 定量・定性の両面から効果を測定する

といった、アジャイルなアプローチが成功の鍵となります。

6-3. 内製と外部パートナーのバランス

複数のLLMを組み合わせたAIオーケストレーションは、一定以上のアーキテクチャ設計力と運用ノウハウを必要とします。すべてを内製化しようとせず、

- 基盤となるAIプラットフォームやオーケストレーションフレームワークは外部サービスを活用

- 自社固有の業務フローやナレッジ部分を内製で作り込む

というハイブリッドなアプローチが現実的です。

6-4. データとプロンプトの品質を重視する

どれだけ多くのLLMを組み合わせても、

- 入力データが古い・誤っている

- プロンプト設計が曖昧

といった状態では、期待した成果は得られません。AIオーケストレーションの効果を最大化するには、

- 社内データの整備・クレンジング

- プロンプトテンプレートの標準化

- ナレッジの継続的な更新

といった地道な基盤整備が欠かせません。

7. まとめ:AIオーケストレーションで「次世代のAI活用」へ

複数のLLMを最適化して活用するAIオーケストレーションは、単なる技術トレンドではなく、企業のAI戦略そのものを左右する重要テーマになりつつあります。

- 単一モデルではなく、タスクごとに最適なLLMを選ぶ

- コスト・性能・セキュリティのバランスをAIオーケストレーションで最適化する

- コンタクトセンター、マーケティング、開発現場、ナレッジマネジメントなど、多様な業務で成功パターンが生まれている

- 小さなPoCから始め、継続的なチューニングとモデル追加で進化させていく

自社でのAI活用を次のステージに進めたいと考えている企業こそ、複数LLMを前提にしたAIオーケストレーションの設計に取り組むべきタイミングと言えるでしょう。

具体的な実装イメージやより詳細な成功事例については、以下の動画も参考になります。

ブログ一覧へ戻る

ブログ一覧へ戻る

LINEで無料相談

LINEで無料相談 お問い合わせ

お問い合わせ