AI化によるセキュリティリスクと対策|データを守りながらAIを安全に活用するための基礎知識

AI化によるセキュリティリスクと対策|データを守りながらAIを安全に活用するための基礎知識

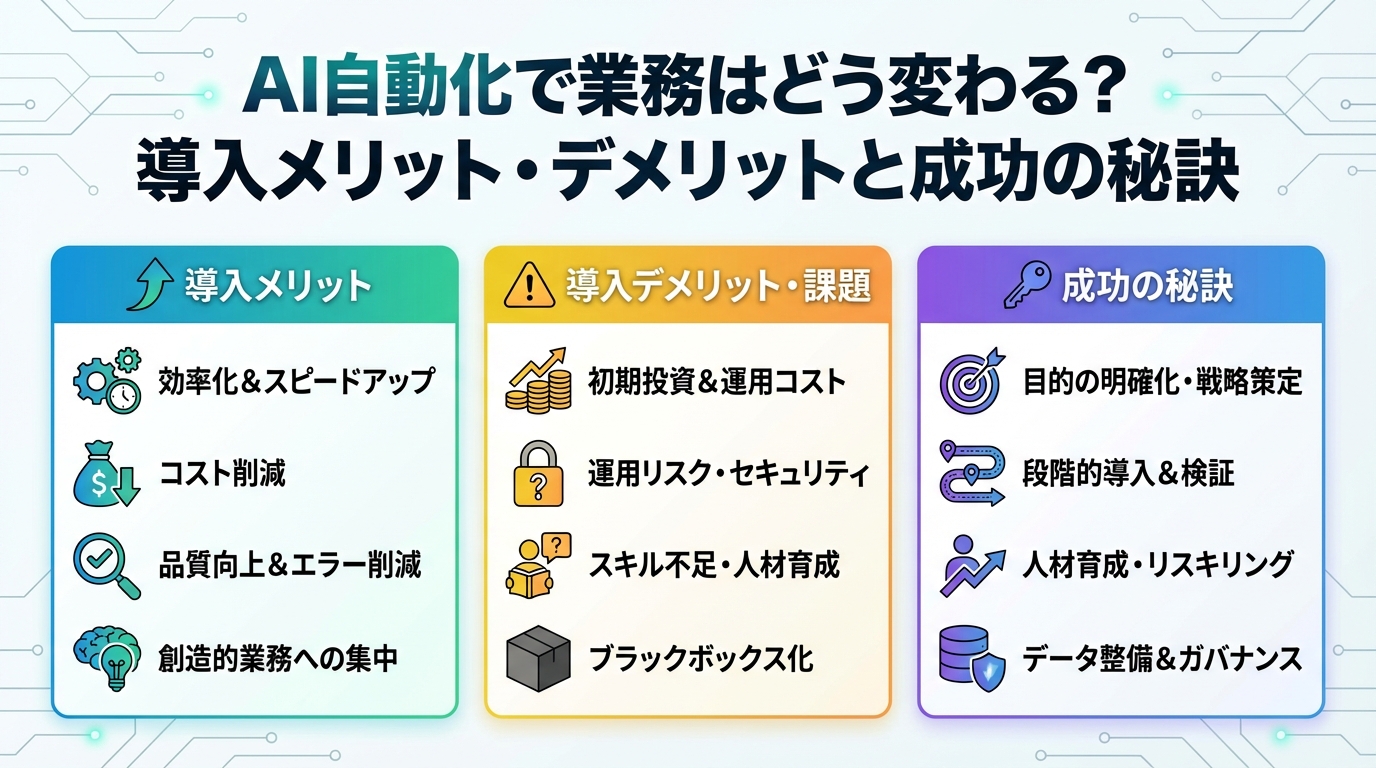

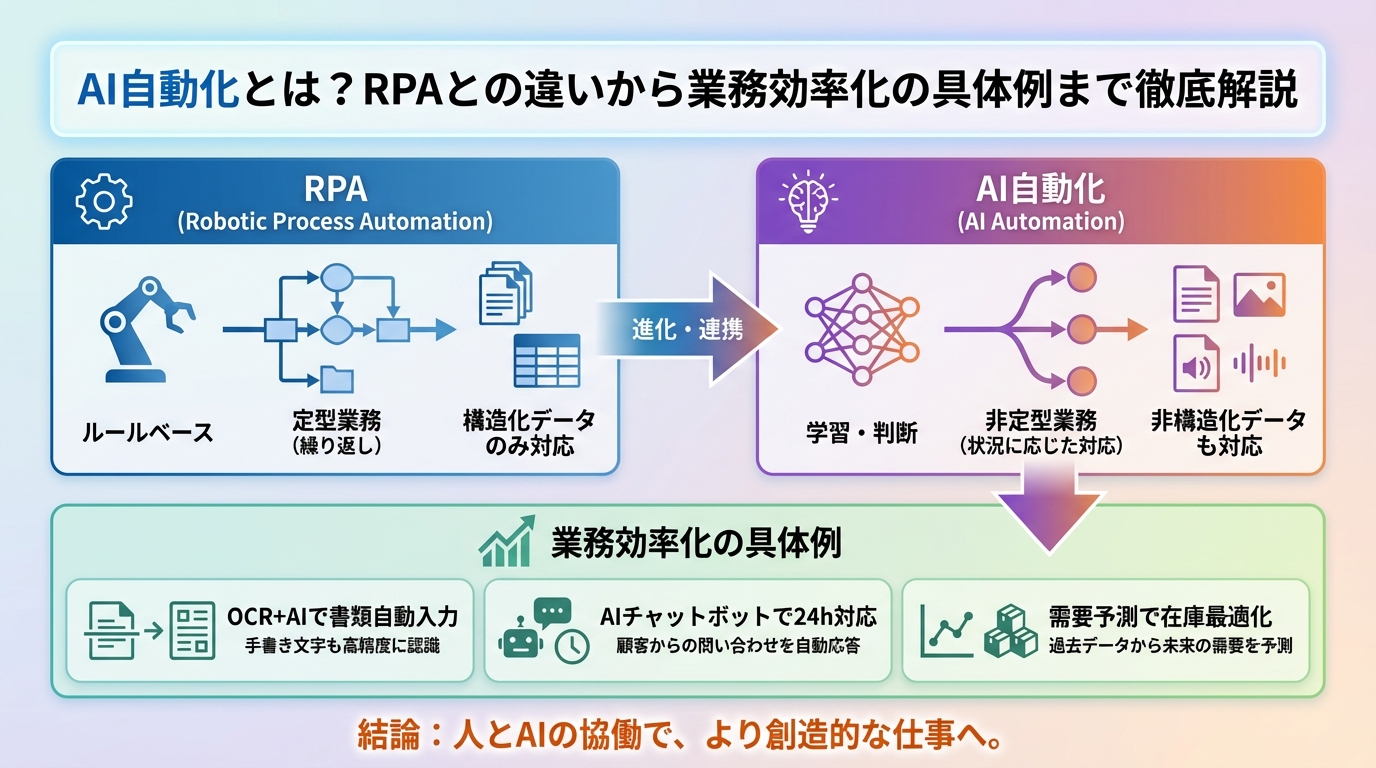

生成AIや機械学習をはじめとする「AI化」は、業務効率化や新しいビジネスモデルの創出に大きく貢献します。一方で、AIを正しく理解しないまま導入した結果、情報漏えい・不正アクセス・コンプライアンス違反などのセキュリティリスクを高めてしまうケースも増えています。

この記事では、AI化による主なセキュリティリスクと、企業や組織が最低限押さえておくべき対策・基礎知識をわかりやすく整理します。これからAIを本格導入したい方、すでに利用しているが不安を感じている方に向けて、実務で役立つポイントをまとめています。

1. なぜ「AI化」でセキュリティリスクが高まるのか

まず押さえておきたいのは、「AIそのものが危険」なのではなく、AIを扱うデータの価値と量が急激に増えることで、攻撃者にとって魅力的なターゲットになるという点です。

1-1. AI時代のデータは「高付加価値」

従来のシステムでも顧客情報や社内資料は重要でしたが、AI時代には次のような特徴が加わります。

- 大量のデータが一箇所に集約される(学習用データ、ログ、プロンプト履歴など)

- そのデータからノウハウ・戦略・アルゴリズムが推測できる

- 生成AIに入力した内容が、そのまま機密情報になり得る

つまり、AIの導入は「重要な情報を一箇所に集めた宝箱」を作るようなものであり、そこをどう守るかがセキュリティ上の最大のテーマとなります。

1-2. AI導入のスピードとガバナンスのギャップ

もう一つの要因は、現場がAIを素早く使い始める一方で、ルールやガバナンスが追いついていないことです。

- 社員が個人アカウントで外部の生成AIサービスを使い始める

- 無料プランに機密情報を入力してしまう

- AIが作った成果物を十分なチェックなしに対外公開する

このような「シャドーIT」的なAI利用は、気づかないうちに情報漏えいリスクやコンプライアンス違反を引き起こします。AI化を安全に進めるには、技術的な防御だけでなく、ルール作りと教育も不可欠です。

2. AI化による代表的なセキュリティリスク

ここでは、AI導入時に特に注意すべき代表的なセキュリティリスクを整理します。

2-1. 機密情報の外部流出(プロンプト経由の漏えい)

もっとも身近で深刻なのが、生成AIへの入力(プロンプト)を通じた情報漏えいです。

たとえば次のような使い方は、非常に危険です。

- 「添付する契約書案を要約して」と言って、顧客名や取引条件が入った原本をそのまま貼り付ける

- 未公開の新製品仕様書を、翻訳や要約のために外部AIに与える

- 従業員の人事評価コメントや給与情報を表にしてもらうために入力する

利用しているAIサービスによっては、入力データが学習やモデル改善に二次利用される場合があります。これを適切に理解せず利用すると、社外に出してはいけない情報が外部に保存され、将来的に予期せぬ形で流出するリスクがあります。

2-2. モデルやアルゴリズム自体への攻撃

より技術的な観点では、AIモデル自体を狙う攻撃も増えています。

- モデル抽出攻撃:外部APIを通じて何度も質問し、内部モデルの振る舞いを推測・コピーする攻撃

- 敵対的サンプル(Adversarial Example):人間には分からない微細なノイズを入力に加え、誤判定を誘発する攻撃

- モデル汚染(Poisoning):学習データに悪意のあるデータを混入させ、特定条件下で誤動作するように仕込む攻撃

これらは主にAIベンダーや高度なシステム開発側の課題ですが、「AIは万能で誤答しない」という思い込みが最も危険です。AIが誤った判断をする前提で、重要な決定には必ず人間の確認プロセスを組み込む必要があります。

2-3. 誤情報・ハルシネーションによる業務リスク

セキュリティというと「外部攻撃」をイメージしがちですが、AIの誤回答(ハルシネーション)も、ビジネス上のリスクとして見逃せません。

- 法的に誤ったアドバイスをもとに契約書を作成してしまう

- 存在しない参考文献や規制を引用してしまう

- 誤った医療情報や技術情報をもとに意思決定してしまう

これらは直接的な情報漏えいではありませんが、コンプライアンス違反や信用失墜、損害賠償につながる恐れがあります。「AIが言ったから正しい」は成立しないことを、組織内で共有しておくことが重要です。

2-4. データ保護規制(個人情報保護法・GDPR等)への抵触

AI化において避けて通れないのが、個人情報保護法やGDPR(EU一般データ保護規則)などの法規制への対応です。

- 本人の同意なく、取得目的を超えて個人データを二次利用していないか

- データを海外のクラウドに転送する際、適切な契約や保護措置を講じているか

- 削除請求や開示請求に対応できるよう、データ管理台帳を整備しているか

AI学習用データやログは、気づかないうちに個人情報や機微情報を多数含むケースがあります。技術部門だけでなく、法務・コンプライアンス部門と連携してルール整備を進めることが欠かせません。

3. データを守りながらAIを活用するための基本方針

では、こうしたリスクを踏まえたうえで、どのようにAIを安全に活用すればよいのでしょうか。ここでは、企業・組織として押さえるべき基本方針を整理します。

3-1. 「機密度」に応じたデータ分類と取り扱いルール

最初のステップは、自社のデータを機密度に応じて分類し、それぞれに対してAIに入力してよいかどうかを定義することです。

例として、次のような区分を設ける方法があります。

- レベルA:社外秘(極秘)

取引条件、原価情報、未発表の研究開発情報、個人を特定できる機微情報など。

→ いかなる外部AIにも入力禁止。 - レベルB:社外秘(限定共有)

社内マニュアル、社外に出していない業務プロセス情報など。

→ 企業契約済みのAI環境のみ可。利用記録を残す。 - レベルC:社内利用

一般的な業務資料、すでに社外でも知られている情報の社内版など。

→ 条件付きでAI利用可。 - レベルD:公開情報

すでにWebやパンフレットで公開している情報。

→ AI入力に制限なし。

このような基準を社内で明文化し、「どのレベルの情報を、どのAIに、どの条件で入力してよいか」をはっきりさせることが、安全なAI活用の出発点です。

3-2. 利用するAIサービスの「データ取り扱い条件」の確認

次に重要なのが、利用するAIサービスごとにデータ取り扱いポリシーを確認することです。具体的には、以下のポイントをチェックします。

- 入力データは学習やモデル改善に使われるか(オプトアウト可能か)

- 入力内容や生成結果のログ保存期間と保存場所(国・地域)はどこか

- データは暗号化されて保存・通信されるか

- 第三者への再提供がないか、サブプロセッサー(再委託先)はどこか

- 企業向けプランで専用環境やプライベートエンドポイントを利用できるか

これらを確認したうえで、機密性の高い業務には企業向けの有料AIサービスを利用し、無料・個人向けサービスは低リスクな用途に限定するのが現実的な方針です。

3-3. 「人間による最終チェック」を前提にした運用

どれだけ安全な環境でAIを動かしても、誤回答やバイアスは完全には避けられません。したがって、特に次のような業務では、必ず人間のチェックを前提としたプロセス設計が必要です。

- 契約書・社外向け規程・プレスリリースなどの法的な意味を持つ文書

- 顧客への提案書・見積書・レポートなど、外部に直接影響する文書

- 人事・評価・採用など、人に影響する判断を含む業務

AIは「草案作成・たたき台作り」に使い、最終版は必ず人間が責任を持ってレビューするという線引きを徹底しておくことで、リスクを大きく減らせます。

4. 具体的なセキュリティ対策:技術・ルール・教育の三本柱

ここからは、実際に何をすればよいのかを、技術的対策・ルール整備・教育・啓発の三つの観点で解説します。

4-1. 技術的なセキュリティ対策

技術的な観点では、次のような対策が基本となります。

アクセス制御と認証の強化

- AIシステム・AI基盤へのアクセスに多要素認証(MFA)を導入する

- 利用者・部署ごとにロールベースアクセス制御(RBAC)を設定し、不要な権限を与えない

- IP制限やVPNで、社外からの無制限アクセスを防ぐ

ログ取得とモニタリング

- どのユーザーが、いつ、どのAI機能を使ったかをログとして記録する

- 大量のデータダウンロードや、不自然な時間帯のアクセスを自動検知する

- 生成結果の利用状況も含め、定期的に監査を行う

データマスキング・匿名化

- 学習データやプロンプトに含まれる個人名・住所・連絡先などをマスキングする

- 統計分析などでは、個人を特定できないよう匿名加工を行ったうえでAIに渡す

- ログにも生データを残さないよう設定を見直す

これらは専門的に見えますが、クラウドベンダーやAIプラットフォームが提供している機能も多く、「何ができるか」を把握したうえで自社に必要なレベルを選ぶことが重要です。

4-2. 利用ルール・ガイドラインの整備

技術だけではリスクは防ぎきれません。社員一人ひとりの行動を変えるには、明確なルールと分かりやすいガイドラインが必要です。

最低限、次のような項目を含めた「AI利用ポリシー」「AI利用ガイドライン」を作成するとよいでしょう。

- 業務で利用してよいAIサービスと、利用禁止のサービスの一覧

- AIへの入力が禁止される情報(個人情報、顧客情報、機密情報など)の具体例

- 生成結果をそのまま使わず、必ず確認・編集を行うことの明記

- 生成コンテンツの著作権・引用ルール(第三者の権利侵害を防ぐ観点)

- インシデント(疑わしい事象)があった場合の報告フロー

また、ただ規程を作るだけでなく、Q&A形式や具体的な事例集を用意し、現場が迷わず判断できるよう支援することも有効です。

4-3. 社員教育とリテラシー向上

AI化における最大のリスクは、ある意味で「人間」です。悪意のある攻撃者だけでなく、悪気のない誤用が大きな問題につながることも少なくありません。

そのため、次のような教育・啓発施策が重要になります。

- AIの仕組み・限界・ハルシネーションについての基礎研修

- 自社ポリシーに基づく具体的なOK/NG例の共有

- 実際に起こった国内外のインシデント事例を紹介し、危機感を共有

- 新人研修や管理職研修に「AIとセキュリティ」を組み込む

特に管理職には、部門としてAIをどう安全に活用するかの設計が求められます。現場任せにせず、部門レベルでのルール作り・チェック体制づくりを進めることが重要です。

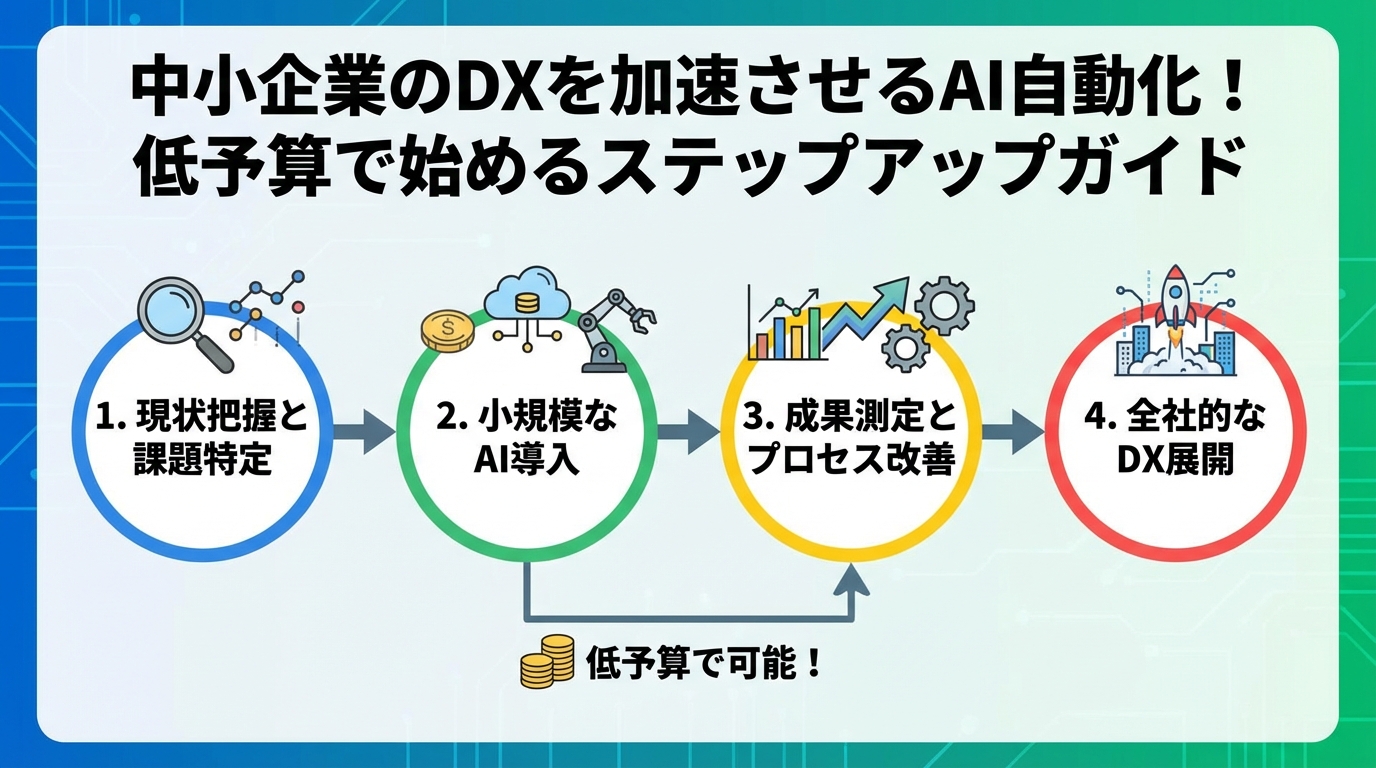

5. 中小企業・個人事業主が押さえるべきポイント

ここまでの内容は、規模の大きな企業を想定した部分もありますが、中小企業や個人事業主にとってもAI化のセキュリティは無視できません。リソースが限られる中で、どこから着手すべきかを整理します。

5-1. 無料AIに「お客様情報」を入れない

まず徹底したいのは、ChatGPTなど無料の外部AIに顧客名や取引条件などを入力しないことです。

- 顧客宛メールの文面作成にAIを使う場合は、固有名詞を伏せたテンプレートを作る

- 実データのレビューではなく、ひな型やサンプルレベルにとどめる

- 実際の契約書・見積書は、社内で最終調整する

これだけでも、情報漏えいリスクは大きく下がります。

5-2. 有料のビジネス向けプランを前向きに検討する

すでにAIを日常的に使っている場合は、ビジネス向け有料プランへの移行を検討する価値があります。多くのサービスでは、ビジネス向けプランで次のようなメリットが得られます。

- 入力データがモデル学習に利用されない設定

- チーム単位でのアクセス権管理

- 利用ログの確認やセキュリティオプションの強化

月額コストはかかりますが、万一の情報漏えい時の損失と比べると、十分ペイする投資と言えるでしょう。

5-3. 「AI任せにしない」姿勢を共有する

人数の少ない組織では、ひとりの判断がそのまま会社の判断になります。そのため、経営者自身がAIの限界を理解し、AI任せにしない姿勢を明確に示すことが重要です。

- AIを「相談相手」「アイデア出しの相棒」として位置づける

- 重要な取引や契約は、必ず専門家(弁護士・税理士など)にも確認する

- AIで作った文章や資料は、自分の言葉で読み直し・修正してから使う

このような意識を持つだけでも、AI化によるセキュリティリスクは大きく軽減されます。

6. AIセキュリティは「守り」だけでなく「攻め」の武器にもなる

最後に、AIとセキュリティを「守り」だけでなく「攻め」にも活かす視点を紹介します。

AIを活用することで、次のようなことが可能になります。

- 膨大なログデータをAIで解析し、不審なアクセスや異常な振る舞いを早期検知する

- セキュリティインシデントの発生パターンを学習し、予兆段階でアラートを上げる

- 社内の問い合わせ対応をAIチャットボットに任せ、セキュリティ担当者の負荷を軽減する

つまり、「AIを守る」だけでなく「AIで守る」という発想がこれからの時代には欠かせません。適切なセキュリティ対策を講じたうえでAIを活用することで、攻撃に強く、効率的な組織運営が可能になります。

まとめ:AIを「怖がる」のではなく「理解して正しく守る」

AI化によるセキュリティリスクは、確かに無視できないものです。しかし、その多くは適切な理解と基本的な対策によって、十分にコントロールできます。

本記事で紹介したポイントをおさらいします。

- AI時代には、データの価値と集中度が高まり、攻撃対象としての魅力が増す

- 最大のリスクは、プロンプト経由の情報漏えいと、ガバナンスが追いつかない「シャドーAI利用」

- 自社データを機密度で分類し、「どの情報をどのAIに入力してよいか」を明確にする

- 利用するAIサービスのデータ取り扱いポリシーを確認し、重要業務は企業向けプランを活用する

- 技術的対策(アクセス制御・ログ・マスキング)、ルール整備、教育の三本柱でリスクを低減する

- AIは「任せる」のではなく「活用する」存在であり、最終判断は人間が行う

AIをむやみに恐れる必要はありません。仕組みとリスクを理解したうえで、適切に守りながら活用することで、AIは強力なビジネスパートナーになります。

自社でAIの導入・活用を検討している方は、まずは本記事の内容をもとに、社内の現状チェックとルール整備から始めてみてください。

より詳しい解説や具体例については、以下の動画も参考になります。

ブログ一覧へ戻る

ブログ一覧へ戻る

LINEで無料相談

LINEで無料相談 お問い合わせ

お問い合わせ