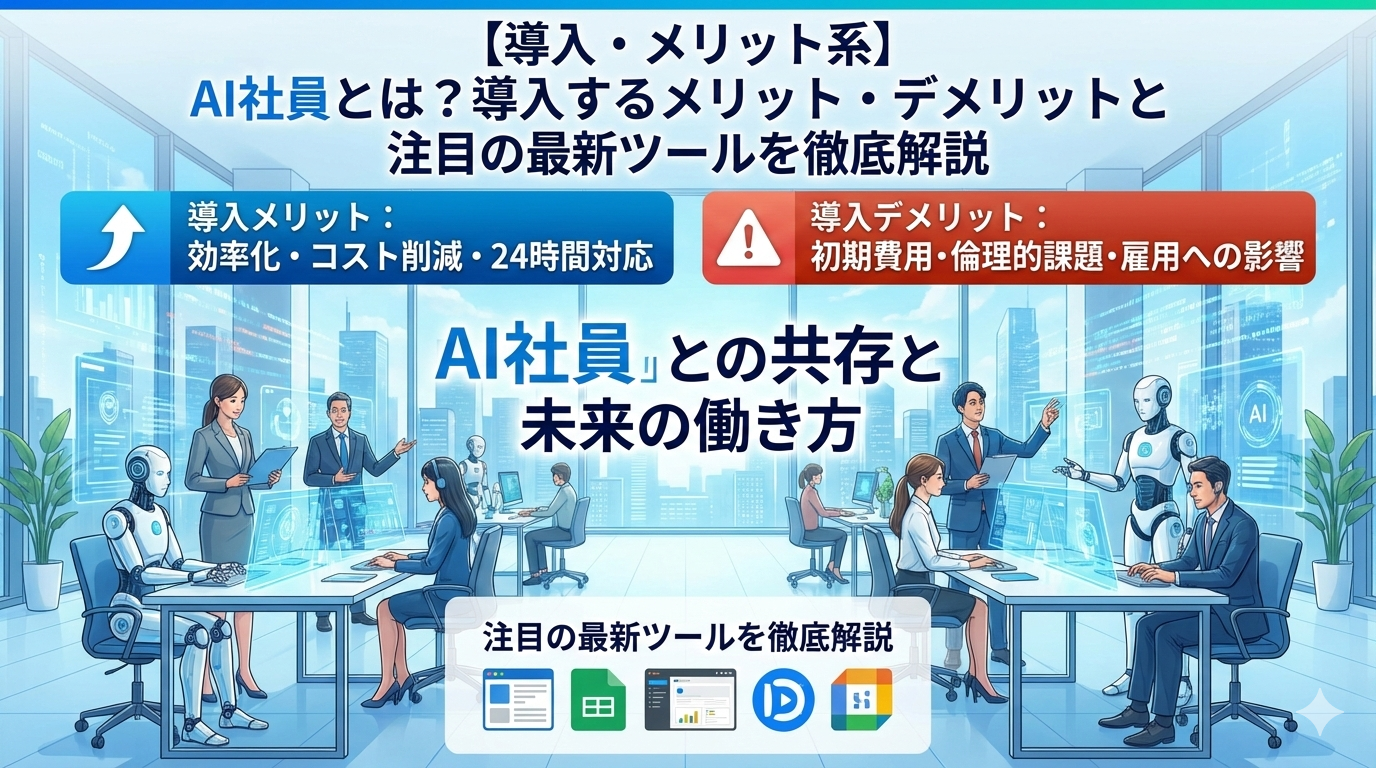

AI技術、特に**生成AI(Generative AI)**の急速な発展と普及は、ビジネスのあり方を根本から変えようとしています。多くの企業が生産性向上やイノベーション創出を目指し、様々なAIツールやAI機能を搭載したSaaS(Software as a Service)を導入し始めています。しかし、その導入プロセスが無秩序かつ管理されていない状態になると、新たな、そして深刻な問題が生じます。

この問題こそが、本記事のテーマである**AIスプロール(AI Sprawl)**です。

本記事では、AIスプロールの定義から、それが企業にもたらす具体的なリスク、そしてこの無秩序な拡大を防ぎ、AI技術を最大限に活用するための具体的な対策までを、SEOのプロとして網羅的かつ深く解説します。AI導入を検討している、または既に複数のAIツールを利用している企業の経営層、IT部門、そして現場の担当者にとって、AIガバナンスとセキュリティの重要性を再認識し、最適な戦略を立てるための羅針盤となることを目指します。

1. AIスプロール(AI Sprawl)の定義と背景

AIスプロールを理解するためには、まずその言葉の由来と、現代のIT環境における特有の背景を把握する必要があります。

1-1. AIスプロールとは何か?

**AIスプロール(AI Sprawl)**とは、企業や組織において、AI機能が搭載されたSaaSや専用ツール、そして従業員が個人的に利用するAIサービスなどが、IT部門の管理や統制を超えて無秩序に導入・利用され、組織内に拡散・乱立している現象を指します。

この「スプロール(Sprawl)」という言葉は元々、「都市のスプロール現象(Urban Sprawl)」から来ており、都心部から外縁部にかけて都市が無計画・無秩序に拡大していく様子を表します。IT分野では、同様に**「SaaSスプロール」や「ITスプロール」**といった言葉が以前から存在し、機能が重複したアプリケーションが乱立し、管理不能になる状態を指していました。

AIスプロールは、このSaaSスプロールやITスプロールの最新版とも言え、特に「AI機能」という、データや倫理的な側面で高いリスクを伴う要素が絡むことで、その問題の深刻度が増しています。

1-2. AIスプロールが発生する背景:生成AIの急速な普及

AIスプロールがこれほどまでに急速に広まった背景には、主に生成AIの爆発的な普及があります。

- 手軽な導入と利用開始: ChatGPTに代表される生成AIサービスは、ウェブブラウザやスマートフォンアプリから個人が簡単にアカウントを作成し、すぐに利用を開始できます。この手軽さが、IT部門の承認を得ずに利用が広がる大きな要因となりました。

- 現場部門主導の導入: マーケティング、営業、開発、人事など、各現場部門がそれぞれの業務課題を解決するために、部門特化型のAIツールや、既存SaaSに追加されたAI機能を独自に導入するケースが増加しました。これは、部門ごとの予算や裁量で導入が進められるSaaSの特徴とも連動しています。

- 多様なAIソリューションの登場: 文章生成、画像生成、コード生成、データ分析支援など、AIの専門分野が細分化され、それぞれのニーズに特化したニッチなAIソリューションが市場に溢れています。これにより、企業内での利用ツールが多岐にわたり、管理の複雑性が増しています。

- IT部門の承認プロセスとの乖離: 新しい技術の出現速度に対し、企業のIT部門やセキュリティ部門の評価・承認プロセスが追いつかず、現場が業務効率を優先して先行導入してしまう「シャドーAI(Shadow AI)」の蔓延を招いています。

この背景から、多くの企業で「気づけば組織内に数十、場合によっては数百ものAI関連アプリケーションやサービスが乱立している」というAIスプロールの状態に陥っています。

2. AIスプロールが企業にもたらす主要なリスク

AIスプロールは、単なるツールの乱立に留まらず、企業の経営、財務、セキュリティ、コンプライアンスといった多岐にわたる領域で、無視できない深刻なリスクをもたらします。

2-1. コストの増大と非効率性の発生(財務・運用リスク)

AIスプロールの最も目に見えやすい問題の一つが、無駄なコストの増大です。

- ライセンス費用の重複: 異なる部門が、類似または機能が重複する複数のAIツール(例:文章校正AIと要約AI、画像生成AIとデザインAIなど)をそれぞれ個別に契約している状態は珍しくありません。これにより、本来一本化できるはずのライセンス費用が無駄に増大します。

- 利用率の低いツールの存在: 部門が試験的に導入したものの、現場で定着しなかったAIツールや、機能のアップデートにより別のツールで代替可能になったにもかかわらず、契約が継続されている「ゾンビAI」が存在する可能性があります。

- 学習コストと非効率: 複数のAIツールが乱立すると、従業員はそれぞれのツールの操作方法やルールを覚える必要があり、ツールの切り替えによる時間的ロスや学習コストが発生し、AI導入による生産性向上効果を相殺してしまいます。

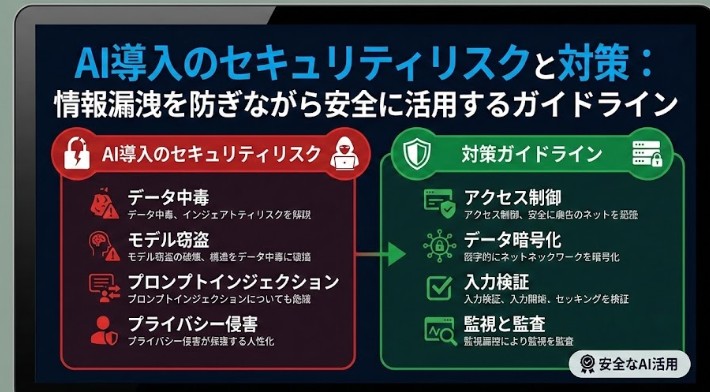

2-2. データ・セキュリティとコンプライアンスの危機(情報漏洩リスク)

AIスプロールは、機密データや個人情報の漏洩に直結する、重大なセキュリティリスクを内包しています。

- シャドーAIによるリスク: IT部門が把握していないシャドーAIの利用は、セキュリティ基準を満たさないツールに企業の機密情報や顧客データが入力されることを意味します。例えば、従業員が契約書案や未公開の財務データをパブリックな生成AIサービスに入力し、そのデータがAIの学習データとして利用されてしまうといった事態が考えられます。

- データ・サイロの形成と可視性不足: ツールごとにデータが分散し、「データ・サイロ」が形成されます。どのデータがどのAIツールで処理され、どこに保存されているのかが不明確になるため、情報漏洩や不正利用が発生した場合の追跡や対応が極めて困難になります。

- コンプライアンス違反のリスク: 顧客データや特定の規制対象となる情報(例:GDPR、CCPA、日本の個人情報保護法など)を、データの保存場所や処理方法に関する規定を満たさない外部AIサービスで処理した場合、重大なコンプライアンス違反につながる可能性があります。

2-3. AIガバナンスと倫理的リスク(信頼性・レピュテーションリスク)

AIスプロールの進行は、企業全体のAIガバナンスを崩壊させ、倫理的な問題を引き起こします。

- アウトプットの信頼性低下: 従業員がバラバラのAIツールを使用すると、同じ業務でもAIによる出力結果の品質や基準が統一されません。これにより、報告書、顧客への提案資料、コーディングなどの成果物に対する品質のばらつきや信頼性の低下を招きます。

- AI倫理ガイドラインの形骸化: 企業が定めたAI利用ガイドラインや倫理規定が、IT部門の統制下にないツールの利用によって守られなくなります。具体的には、AIによる著作権侵害リスクの高い画像生成、差別的・偏見的な内容を含む文章の生成などが野放しになる恐れがあります。

- レピュテーションリスク: AIツールの不適切な利用や、AIが出力した誤情報が外部に漏れることで、企業の信頼性やブランドイメージが大きく損なわれるレピュテーションリスクが発生します。

3. AIスプロールを解消するための具体的な対策と戦略

AIスプロールは、企業にとって避けられない課題ではありますが、適切な戦略とガバナンス体制を構築することで、リスクを最小限に抑え、AIの恩恵を最大限に享受できます。

3-1. 統制のためのガバナンス体制の構築

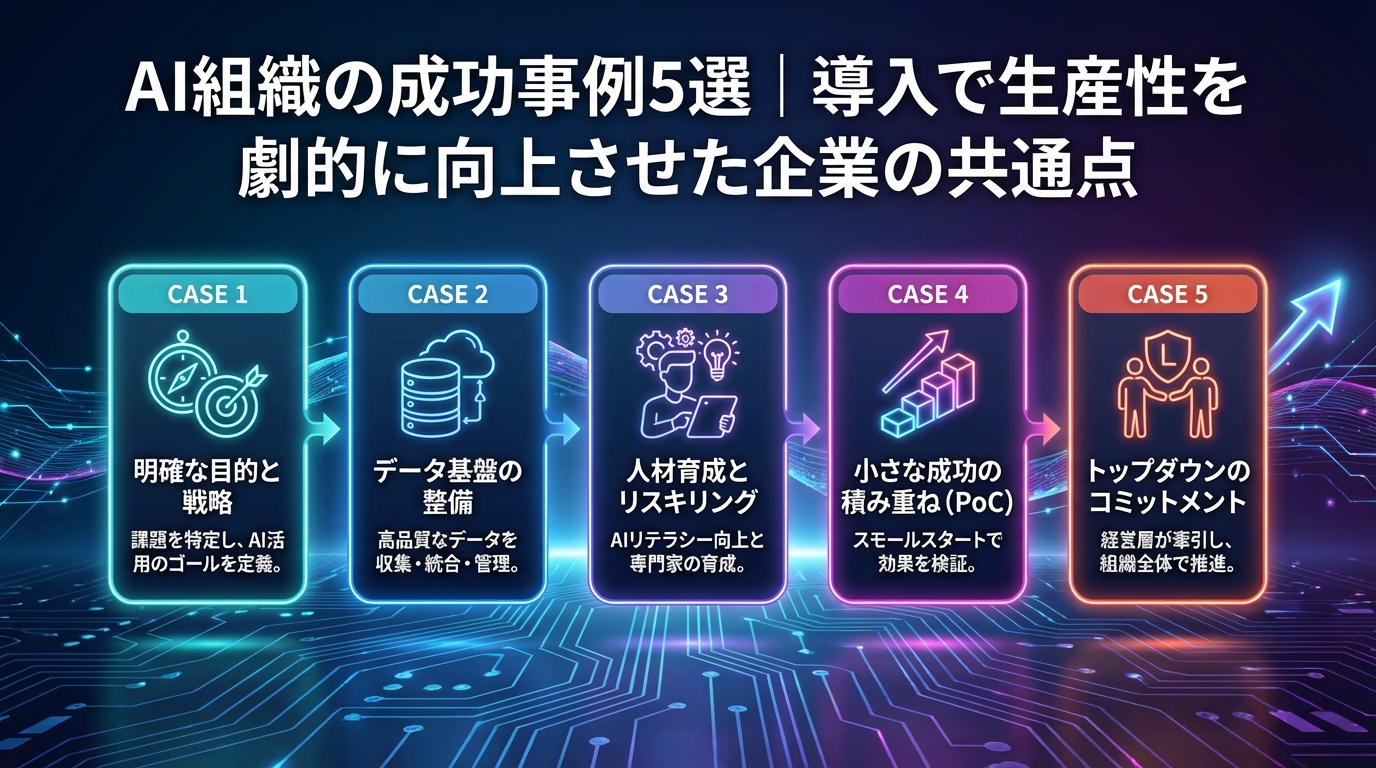

AIスプロール対策の土台となるのは、全社的なAIガバナンス体制の構築です。

1. AI利用ポリシーとガイドラインの策定

- 利用の承認プロセス: 業務でのAIツール・サービスの利用について、IT部門やセキュリティ部門による事前承認を必須とするプロセスを明確に定義します。

- データ入力のルール: どのような情報(機密情報、個人情報、顧客情報など)をAIサービスに入力して良いか、または絶対に入力してはいけないかを具体的に示します。特に、「AIの学習に利用されない」ことを保証できる企業向けプランの利用を原則とします。

- 出力物のチェック体制: AIが生成した成果物(文章、コード、画像など)について、最終的な責任は人間にあることを周知徹底し、利用者がファクトチェックや著作権侵害の有無を確認する手順を義務付けます。

2. AI統制委員会(CoE: Center of Excellence)の設立

- IT部門、セキュリティ部門、法務部門、そして各現場部門の代表者を含む横断的な委員会を設立します。

- この委員会が、全社的なAI戦略の立案、新規AIツールの評価・承認、利用状況のモニタリング、およびポリシーの継続的な見直しを行います。

3-2. ツールの集約と可視化(アセットマネジメント)

無秩序なAIツールの利用を特定し、整理・集約することは、コスト削減とセキュリティ強化の鍵となります。

1. 現状の利用状況の棚卸しと可視化

- 全従業員に対し、現在業務で利用しているAIツール(SaaS、アプリケーション、個人アカウントで利用しているパブリックAIサービスも含む)について、利用目的、入力データ、頻度を報告させる**全社的なアンケート調査やIT資産管理(ITAM)**を実施します。

- これにより、シャドーAIを含めたAIアセットの全体像を把握します。

2. 認定AIツールのリスト化と統一

- 棚卸しの結果に基づき、セキュリティとコンプライアンス基準を満たし、全社または部門共通で利用すべきAIツールを「認定AIツールリスト」として選定し、従業員に公開します。

- 機能が重複するツールについては、コスト効率と機能性を考慮して**最適化(一本化)**を進めます。

3. AIガバナンスツールの導入

- AIツールの利用状況をリアルタイムで監視し、不適切な利用(例:機密情報のアップロード)を検知・ブロックできるAIガバナンス・セキュリティ専門のツール(例:CASBやDLP機能と連携したAI特化ソリューション)の導入を検討します。これにより、シャドーAIの利用を技術的に抑止します。

3-3. 教育と啓発(リスク意識の向上)

技術的な統制だけでなく、従業員一人ひとりのAI利用に関する意識とリテラシーを高めることが不可欠です。

- 全従業員への定期的な研修: AI利用ポリシー、データ入力の具体的な禁止事例、著作権や機密保持に関するリスクなどをテーマにした定期的な研修を実施します。

- 社内コミュニケーションの強化: AI統制委員会などが中心となり、認定ツールの使い方や最新のAIリスク情報などを共有する社内ポータルを設置し、従業員がいつでも正しい情報にアクセスできるようにします。

- 罰則規定の明確化: ポリシーに違反し、企業に重大な損害を与えた場合の罰則規定を明確にし、従業員の緊張感を維持します。

4. AIスプロール対策の先の戦略:エンタープライズAIの推進

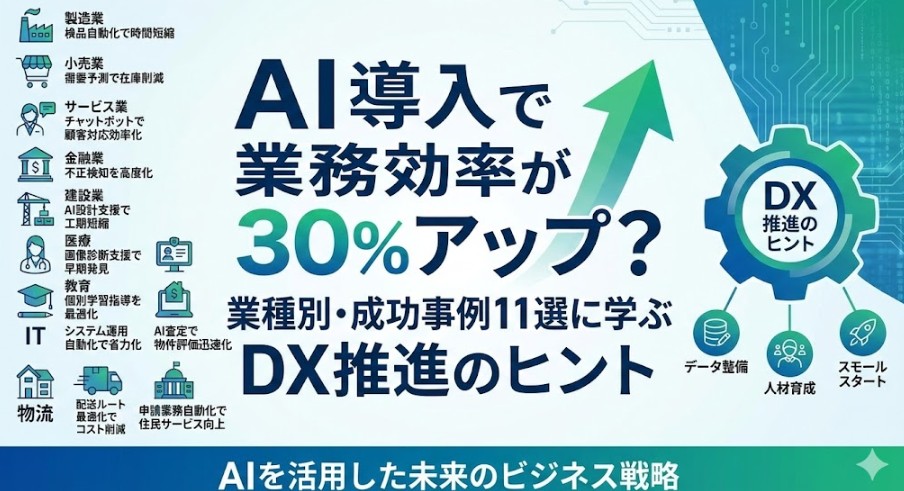

AIスプロールを解消し、統制された環境を整備することはゴールではなく、企業がAI技術を真に競争優位性につなげるためのスタートラインです。対策の先にあるのは、全社的に最適化されたエンタープライズAI戦略の推進です。

4-1. 統合型AIプラットフォームの構築

AIスプロールを根本から解決する一つの方法は、複数のAI機能を一つの統合型AIプラットフォームに集約することです。

- 単一の基盤: 企業内データを安全に格納し、そのデータにアクセスしてAIが動作する単一のセキュアな基盤を構築します。これにより、データ・サイロを解消し、一貫したセキュリティとガバナンスを適用できます。

- 部門間の連携強化: 各部門が同じプラットフォーム上でAI機能を利用することで、知見やデータ、成功事例が共有されやすくなり、全社的なAI活用のレベルが底上げされます。

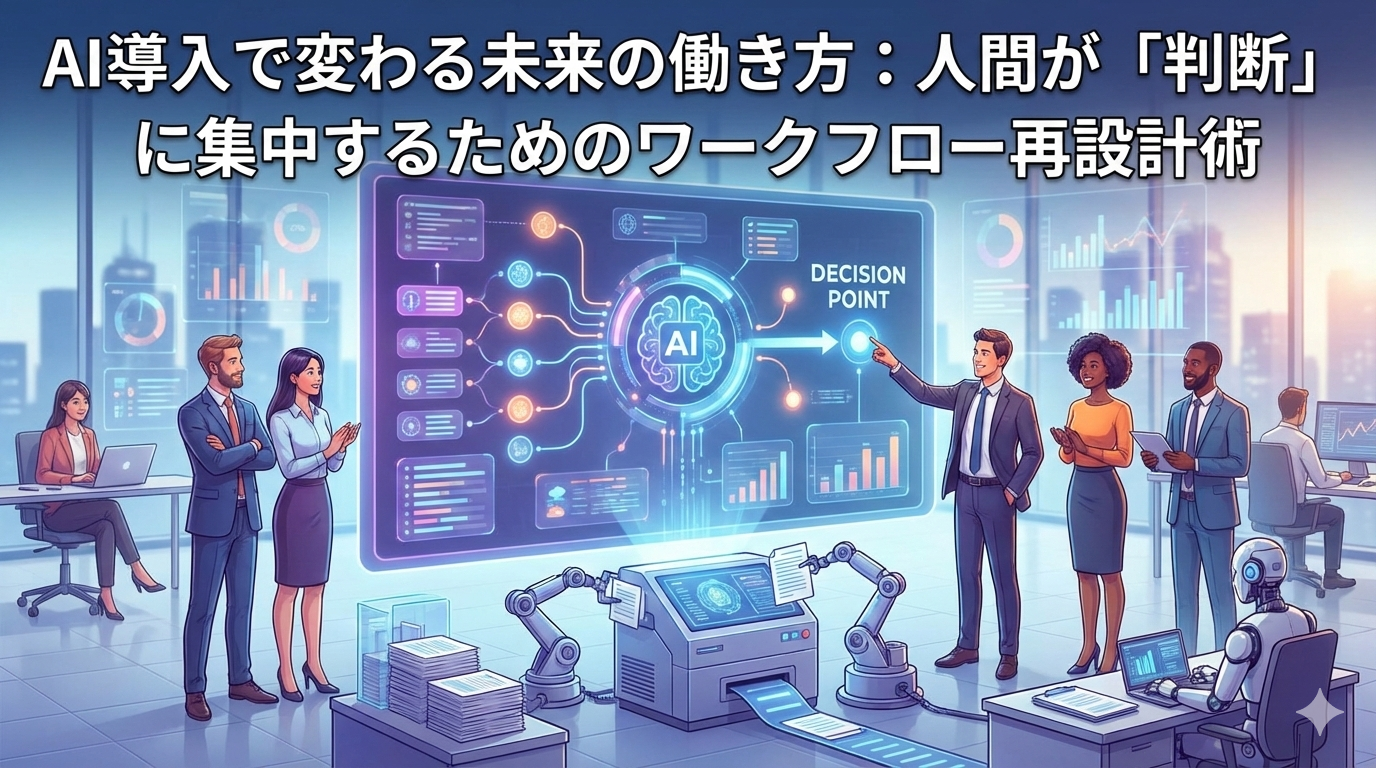

4-2. 業務プロセスの再設計(AIファースト)

AIスプロール解消の過程で、企業は既存の業務プロセスがAIによってどのように最適化されるべきかを再評価できます。

- ボトルネックの特定: どの業務にAIが最も貢献できるかを特定し、その業務に認定AIツールを深く組み込むための業務プロセス自体の再設計を行います。

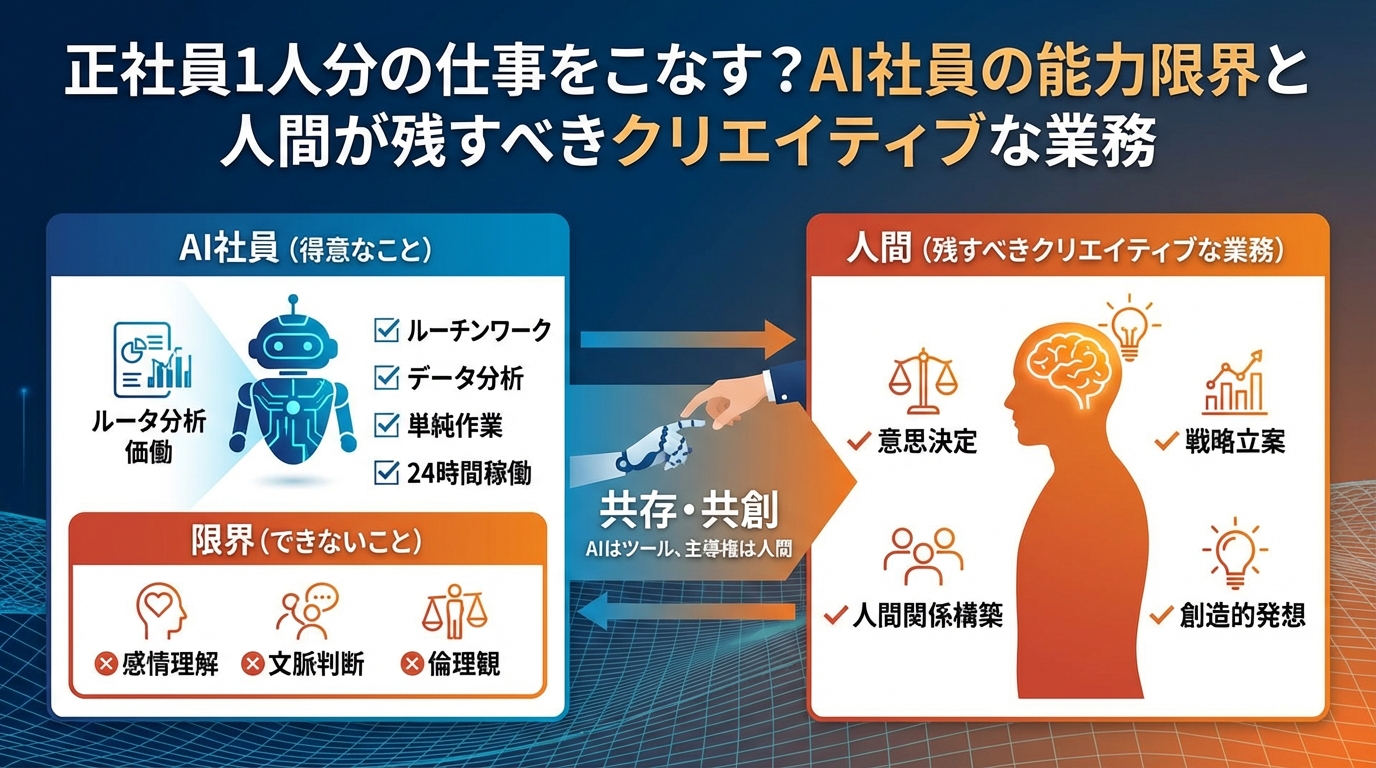

- AIによる自動化領域の拡大: 承認されたツール群を使い、より高度で複雑な自動化(RPAとAIの連携など)を進めることで、人間にしかできない創造的な業務へリソースを集中させます。

4-3. 投資対効果(ROI)の明確化

AIスプロールの解消は、コスト削減だけでなく、AI投資の真の価値を測定することを可能にします。

- 利用状況のデータ化: 統制された環境下では、どのAIツールが、どの部門で、どれだけの時間、どれだけの成果を生み出しているかを定量的に計測できます。

- 戦略的な投資判断: このデータに基づいて、**ROI(投資対効果)**の高いAIソリューションへの投資を拡大し、効果の低いツールの利用を段階的に終了させるなど、データに基づいた戦略的な意思決定が可能になります。

5. まとめ:AIスプロールを克服し、戦略的なAI活用へ

AIスプロール(AI Sprawl)は、生成AIの普及という技術革新の光がもたらした影の部分です。無秩序なツールの乱立は、コスト増大、深刻なセキュリティリスク、そしてAIガバナンスの崩壊という、企業経営にとって致命的な問題を引き起こす可能性があります。

しかし、これは同時に、企業がAI技術を「単なる便利なツール」から「戦略的な経営資産」へと昇華させるための重要な転換点でもあります。

AIスプロールを克服し、AIを企業の競争力に変えるためには、以下の3つの柱を同時に推進することが不可欠です。

- 強固なガバナンス体制の構築: AI利用ポリシー、データ入力ルール、統制委員会の設立による全社的な統制。

- アセットの可視化と最適化: シャドーAIの特定、認定ツールのリスト化と統一、ガバナンスツールの導入による環境整備。

- 教育と意識改革: 全従業員のリテラシー向上とリスク意識の徹底。

AI技術の進化は止まりません。AIスプロール対策は、一度行えば終わりではなく、継続的なモニタリングとポリシーの見直しが必要です。本記事で解説した戦略と対策を実践することで、貴社がAIの力を最大限に引き出し、安全かつ効率的にビジネスを成長させていくための一助となれば幸いです。

ブログ一覧へ戻る

ブログ一覧へ戻る

LINEで無料相談

LINEで無料相談 お問い合わせ

お問い合わせ